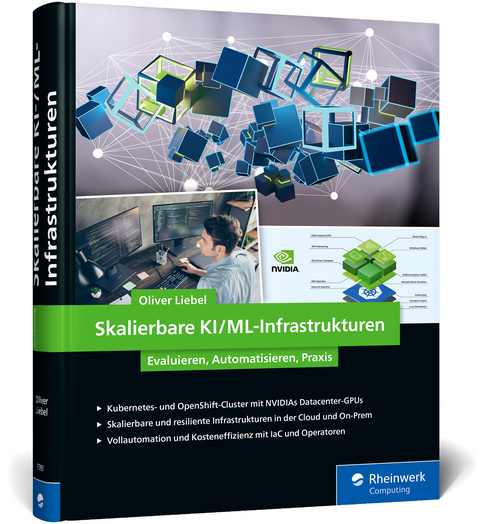

Skalierbare KI/ML-Infrastrukturen

Rheinwerk (Verlag)

978-3-8362-7393-0 (ISBN)

- Kubernetes- und OpenShift-Cluster mit NVIDIA-GPUs

- Skalierbare und resiliente Infrastrukturen in der Cloud oder On-Prem

- Vollautomation mit IaC und Operatoren

Moderne KI/ML-Modelle brauchen leistungsstarke Infrastrukturen. Wie Sie abseits der Hypes resiliente, hochautomatisierte und autoskalierbare Systeme für Produktiv-Workloads aufbauen, zeigt Ihnen Oliver Liebel in diesem Wegweiser.

Sie erfahren, wie Sie NVIDIAs Datacenter-GPUs nahtlos in Hypervisoren und moderne Container-Infrastrukturen integrieren, sie Operator-gestützt mit Kubernetes bzw. OpenShift verwalten und daraus praxistaugliche Setups machen.

Betrachtet wird der ganze Infrastruktur-Stack: Von On-Premises-Installationen auf vSphere oder Cloud-Setups auf GCP und AWS über Plattform-Automation per IaaS/IaC sowie den GPU- und Network-Operatoren bis hin zu einem Ausblick auf AI End-to-End-Tool-Stacks.

Best Practices für Planung und Umsetzung

Wenn Daten im Tera- oder Peta-Bereich verarbeitet werden müssen und Investitionen im sechs- oder siebenstelligen Bereich anstehen, ist durchdachte Planung unabdingbar. Mit Hintergrundwissen und fundierten Markteinschätzungen treffen Sie die richtigen Entscheidungen für zukunftssichere KI/ML-Projekte und haben alle Kostenfaktoren im Blick.

Bewährte Technologie-Stacks für praxistaugliche Setups

Sie arbeiten bereits mit Kubernetes und OpenShift? Dann wissen Sie, wie viel bei einer Cluster-Konfiguration schiefgehen kann. Oliver Liebel kennt komplexe Systeme aus jahrelanger Erfahrung und zeigt Ihnen mögliche Probleme und Fallstricke auf. Auf dieser Basis entsteht ein moderner Infrastruktur-Stack für KI-/ML-Anwendungen: sowohl in der Cloud als auch On-Premises.

Setzen Sie auf Industriestandards

Datacenter-GPUs von NVIDIA sind die Arbeitspferde moderner KI/ML-Infrastrukturen. In enger Zusammenarbeit mit NVIDIA wurden die vorgestellten Setups getestet und evaluiert. Profitieren Sie von dieser Praxiserfahrung und erfahren Sie, wie Sie leistungsstarke GPUs richtig in vollautomatisierte und skalierbare Container-Cluster integrieren.

Zuverlässig und automatisiert

Operator-gestützte Vollautomation ist ein Muss, um containerisierte KI/ML-Infrastrukturen skalierbar, resilient und kosteneffizient zu betreiben. Hands-on führen Sie zahlreiche Beispiele durch Konfigurationen von Praxissystemen, die durch ihren hohen Automationsgrad und Auto-Skalierbarkeit für aktuelle und zukünftige Anforderungen gerüstet sind.

Aus dem Inhalt:

KI/ML: Grundlagen und Use Cases

Infrastruktur planen: On-Premises, Cloud oder Hybrid?

Technischer Background: KI/ML mit NVIDIA-GPUs

GPU-Modi: Passthrough-MIG vs. MIG-backed vGPU vs. vGPU

NVIDIA-GPUs auf vSphere On-Prem implementieren

NVIDIA AI Enterprise

KI/ML-Cluster mit Kubernetes und OpenShift

GPU-spezifische Operatoren

GPU-Cluster mit OpenShift

Von CI/CD über GitOps zu MLOps

ML-Pipelines & AI End-to-End

Dipl.-Ing. Oliver Liebel ist LPI-zertifizierter Linux-Enterprise-Experte und offizieller Business Partner von SUSE und Red Hat. Als Dozent, Autor, Berater und Projektleiter ist er seit vielen Jahren für namhafte Unternehmen, internationale Konzerne und Institutionen auf Landes- und Bundesebene tätig. Dabei blickt er auf 25 Jahre Berufserfahrung zurück.

1. Vorwort ... 19

1.1 ... Vorbemerkungen ... 28

1.2 ... Was dieses Buch sein bzw. nicht sein soll ... 31

1.3 ... Wie dieses Buch zu lesen ist ... 34

1.4 ... Thematischer Überblick - was wird in welchen Kapiteln behandelt ... 34

TEIL I. Technische Foundations zu skalierbaren KI/ML-Infrastrukturen ... 39

2. Am Anfang war die Dunkelheit ... 41

2.1 ... Eine kurze Einführung: KI/ML-Systeme - und alles wird gut. Oder eher nicht? ... 42

2.2 ... Use Cases für KI/ ML-Anwendungen - Auszüge ... 45

2.3 ... Fehlerfreie KI? Sicher nicht. ... 50

2.4 ... Einige Grundbegrifflichkeiten im KI/ML-Kontext ... 52

3. High-Level-Vorbetrachtungen zur Implementierung von skalierbaren KI/ML-Infrastrukturen ... 65

3.1 ... Bare-Metal, Virtualisierung, Containerisierung ... 65

3.2 ... Generelle Infrastruktur-Fragen: Cloud vs. On-Prem, Managed Server, hybrider Mischbetrieb, dedizierte KI-Plattformen (NVIDIA DGX) ... 69

3.3 ... Entscheidungshilfe: Reguläre GPU-Server, KI/ML-Boliden wie DGX oder alles in die Cloud? ... 85

3.4 ... Generelle GPU-Hardware-Fragen: NVIDIA vs. AMD vs. Intel vs. Googles TPU ... 86

4. NVIDIA-Datacenter-GPUs und mehr - technischer Background ... 93

4.1 ... NVIDIA und ML-Cluster ... 93

4.2 ... Partitionierte GPUs mit NVIDIAs vGPU und MIG ... 95

4.3 ... vGPU - Virtual GPU ... 97

4.4 ... MIG - Multi-Instance GPU ... 113

4.5 ... MIG: Multi-Tenancy revisited ... 128

4.6 ... Technische Daten und Preise ausgewählter NVIDIA Datacenter-GPUs ... 134

4.7 ... GPU-Time-Slicing und GPU-Overcommitment ... 137

4.8 ... NVLink und NVSwitch: GPU Big Blocks - Bündelung multipler GPUs ... 139

4.9 ... GPUDirect (RDMA) ... 142

4.10 ... GPU-Performance in ML-Trainings - Bare-Metal vs. vGPU/MIG ... 145

4.11 ... NVIDIA-Datacenter-Produkte: The Road Ahead ... 149

TEIL II. Implementierung von skalierbaren KI/ML-Infrastrukturen ... 151

5. Implementierung: vSphere als Hypervisor für skalierbare ML-Infrastrukturen ... 153

5.1 ... Hardware-Voraussetzungen und Vorbetrachtungen (vSphere/On-Prem) ... 153

5.2 ... Preflights ... 154

5.3 ... Setup des GPU-Managers/vGPU-Host-Drivers (ESXi/vSphere 7) ... 160

5.4 ... VM-Templates mit GPUs erstellen ... 164

5.5 ... MIG-Mode auf dem Hypervisor aktivieren ... 171

6. Der NVIDIA AI Enterprise (NVAIE)-Stack - infrastrukturrelevante Betrachtungen ... 181

6.1 ... Vorbetrachtungen ... 181

6.2 ... Motivation ... 182

6.3 ... Plattformen für NVAIE ... 183

6.4 ... NVAIE vs. vGPU vs. Free GPU Operator ... 185

6.5 ... NVAIE in der Public Cloud ... 186

6.6 ... NVAIE ist Pflicht für skalierbare ML-Cluster? ... 187

6.7 ... NVAIE als AI-End-to-End-Platform ... 187

7. vGPU-/NVAIE-Preflights: Lizenzierung ... 189

7.1 ... Grundsätzliches: vGPU- vs. NVAIE-Lizenzen und DLS vs. CLS ... 189

7.2 ... NVIDIA Licensing System (NLS) ... 194

7.3 ... License Server: DLS vs. CLS ... 196

7.4 ... Self-Hosted License Server: DLS und Legacy License Server ... 197

7.5 ... Cloud-Hosted License Server: CLS ... 205

8. Kubernetes-basierte Plattformen für skalierbare, GPU-Accelerated KI/ML-Cluster ... 209

8.1 ... The Road so far ... 209

8.2 ... Generelle Plattform-Fragen: (Vanilla-)Kubernetes-Derivate und OpenShift im Überblick ... 211

8.3 ... Vanilla Kubernetes ... 213

8.4 ... VMwares Tanzu und das Eckige, das durchs Runde soll ... 217

8.5 ... OpenShift ... 219

8.6 ... Abschließende LTS-Betrachtungen ... 220

8.7 ... Kubernetes-Basics - Aufbau des Systems ... 222

8.8 ... Kubernetes-Basics - Ressourcen/Workloads ... 225

8.9 ... Sonstige im Folgenden verwendete, Kubernetes-spezifische Tools ... 236

9. Preflights für GPU-Accelerated Container-Cluster: Operatoren ... 241

9.1 ... Generelle Vorbetrachtungen zum Thema Operatoren ... 241

9.2 ... Operator-Typen und Maturitäts-Level: Helm vs. Ansible vs. Go ... 247

9.3 ... Die wichtige Rolle von Operatoren im auto-skalierbaren KI/ML-Stack ... 250

9.4 ... NVIDIAs GPU-Operator - die Architektur ... 251

9.5 ... Automatische Provisionierung eines Nodes durch den GPU-Operator ... 258

9.6 ... NVIDIAs Network-Operator - die Architektur ... 268

9.7 ... Komponenten des Network-Operators im Überblick ... 270

10. OpenShift (GPU-Accelerated) - Multiplatform (Cloud und On-Premises) ... 273

10.1 ... Theoretische Vorbetrachtungen ... 273

10.2 ... Konzeptionelle Vorbetrachtungen zum Setup (On-Prem mit vSphere) ... 275

10.3 ... On-Premises: OpenShift 4.10-Setup - Installer Provisioned Infrastructure (IPI) auf vSphere ... 277

10.4 ... Preflights für skalierbare GPU-Nodes unter OpenShift: MachineSets, MachineConfigs und Machine-/Cluster-Autoscaler ... 286

10.5 ... Cluster-Autoscaler/Machine-Autoscaler ... 294

10.6 ... vGPU-/MIG-spezifisches Setup des OpenShift-Clusters: NFD- und GPU-Operator ... 306

10.7 ... Automatisches vGPU-Node-Setup per Operator - OpenShift-MachineSet mit Tesla T4 ... 320

10.8 ... Automatisches MIG-Slice-Setup per Operator - A30 on-premises ... 327

10.9 ... Cloud: GPU-MachineSets in OpenShift 4.10 unter GCP mit A100-Instanzen (MIG-Partitionen via Operator) ... 333

10.10 ... GPU-Sharing/-Overcommitment ... 353

10.11 ... Setup des Network-Operators (OpenShift on vSphere [IPI]) für GPUDirect RDMA ... 371

10.12 ... KI/ML-System-Performance-Test (OpenShift on DGX) ... 386

10.13 ... GPU-Dashboard für OpenShift ... 387

11. GKE - Google Kubernetes Engine Cluster (GPU-Accelerated) ... 389

11.1 ... Überblick ... 389

11.2 ... Setup-Variante 1: GKE-Cluster mit separatem Node-Pool für GPU-Nodes ... 390

11.3 ... Setup-Variante 2: GPU-Cluster auf GKE direkt ausrollen ... 395

TEIL III. ML-Stacks für skalierbare KI/ML-Infrastrukturen ... 397

12. CI/CD-Pipelines, GitOps und MLOps ... 399

12.1 ... Von der (ML-)Insel zur Pipeline ... 399

12.2 ... CI/CD und GitOps ... 400

12.3 ... GitOps-Pipeline-Modelle ... 401

12.4 ... MLOps, LTS und Portierbarkeit ... 404

13. ML-Pipeline- und AI-End-to-End-Implementierungen mit Kubeflow/Vertex AI, Open Data Hub und NVIDIA AI Enterprise ... 411

13.1 ... ML-Pipeline-Implementierungen in Kubernetes-basierten Clustern ... 411

13.2 ... Kubeflow ... 417

13.3 ... Hands-on: Kubeflow unter GKE in der Praxis ... 422

13.4 ... Open Data Hub ... 430

13.5 ... Hands-on: Open-Data-Hub-Setup unter OpenShift ... 433

13.6 ... NVIDIA AI Enterprise (AI-End-to-End-relevante Betrachtungen) ... 442

13.7 ... Hands-on: NVIDIA AI Enterprise (AI End-to-End) unter OpenShift ... 447

14. The Road Ahead ... 459

Index ... 463

»Im Rahmen dieser Buchbesprechung ist es gerade einmal möglich, an der Oberfläche von Oliver Liebels Werk zu kratzen. Das liegt weniger an den rund 470 Seiten, als vielmehr am wahrlich komprimierten Inhalt, den der Autor verständlich vermittelt. Er führt Schritt für Schritt durch das Planen und Aufbauen einer eigenen ML/KI-Infrastruktur, ohne unnötige Worte zu verlieren. Auf den Punkt geschrieben, setzt er allerdings Vorkenntnisse in Sachen IT-Administration, Virtualisierung wie auch Cluster voraus.« IT Administrator 202305

»Im Rahmen dieser Buchbesprechung ist es gerade einmal möglich, an der Oberfläche von Oliver Liebels Werk zu kratzen. Das liegt weniger an den rund 470 Seiten, als vielmehr am wahrlich komprimierten Inhalt, den der Autor verständlich vermittelt. Er führt Schritt für Schritt durch das Planen und Aufbauen einer eigenen ML/KI-Infrastruktur, ohne unnötige Worte zu verlieren. Auf den Punkt geschrieben, setzt er allerdings Vorkenntnisse in Sachen IT-Administration, Virtualisierung wie auch Cluster voraus.«

| Erscheinungsdatum | 22.12.2022 |

|---|---|

| Verlagsort | Bonn |

| Sprache | deutsch |

| Maße | 190 x 240 mm |

| Einbandart | gebunden |

| Themenwelt | Mathematik / Informatik ► Informatik ► Netzwerke |

| Informatik ► Theorie / Studium ► Künstliche Intelligenz / Robotik | |

| Schlagworte | Buch • Buch Lernen Tutorial Anleitung Wissen • Container • Datacenter • KI/ML • Kubernetes- OpenShift-Cluster • Künstliche Intelligenz • machine learning • MLOps GitOps AI End-to-end • NVIDIA -GPUs • On-Premises Cloud Hybrid On Prem • Passthrough MIG vGPU • Produktivität • VMware vSphere |

| ISBN-10 | 3-8362-7393-4 / 3836273934 |

| ISBN-13 | 978-3-8362-7393-0 / 9783836273930 |

| Zustand | Neuware |

| Haben Sie eine Frage zum Produkt? |

aus dem Bereich